ปัญหาแบบไหนที่คอมพิวเตอร์ควอนตัมทำได้ดี?

ดูวิดีโอเกี่ยวกับการประยุกต์ใช้การประมวลผลควอนตัมจาก Olivia Lanes หรือเปิดวิดีโอในหน้าต่างแยกบน YouTube.

บทนำ

ในบทเรียนที่แล้ว เราเจาะลึกปัญหาเดียวอย่างละเอียด ซึ่งก็คือการแก้ปัญหา Max-Cut โดยใช้การกำหนดสูตร QUBO วันนี้เราจะเปลี่ยนวิธีการและพูดถึงการประยุกต์ใช้ในระยะใกล้อย่างกว้างขวางมากขึ้น เราจะเริ่มด้วยการให้ภาพรวมว่าเราตัดสินใจเลือกประเภทของปัญหาที่คิดว่าอาจได้ประโยชน์จากโซลูชันควอนตัมได้อย่างไร จากนั้นจะดูตัวอย่างผลงานล่าสุดในชุมชนของเรา สิ่งนี้จะช่วยให้คุณเริ่มพัฒนาสัญชาตญาณสำหรับปัญหาการประมวลผลควอนตัมประเภทต่าง ๆ และวิธีที่เราเข้าถึงการแก้ปัญหาเหล่านั้น

ความยากบนคลาสสิกและควอนตัม

ก่อนที่จะไปดูตัวอย่าง ขอพูดถึงวิธีที่เราศึกษาและจัดหมวดหมู่ความยากของปัญหาต่าง ๆ กันก่อน ปัญหาบางอย่างแก้ได้ง่ายบนคอมพิวเตอร์คลาสสิก และเราไม่จำเป็นต้องใช้คอมพิวเตอร์ควอนตัมเลย ในทางกลับกัน มีปัญหาที่ยากมากซึ่งคอมพิวเตอร์ควอนตัมจำเป็นในการแก้ ตัวอย่างที่มีชื่อเสียงได้แก่การหาตัวประกอบเฉพาะของจำนวนเต็มขนาดใหญ่มาก การเข้ารหัส RSA อาศัยความยากของปัญหานี้ และ Shor's algorithm ถูกออกแบบมาเพื่อแก้บนคอมพิวเตอร์ควอนตัม อีกตัวอย่างหนึ่งคือการหาคำตอบในชุดข้อมูลที่ไม่ได้เรียงลำดับ ซึ่งในทางทฤษฎีแก้ได้ด้วยอัลกอริทึมควอนตัมที่รู้จักกันในชื่อ Grover's algorithm อย่างไรก็ตาม ผู้เชี่ยวชาญส่วนใหญ่เห็นตรงกันว่าอัลกอริทึมประเภทนี้จะต้องการการนำการแก้ไขข้อผิดพลาดไปใช้งาน และเทคโนโลยียังไม่ถึงจุดนั้น

ดังนั้น เรากำลังมองหาปัญหาที่อยู่ในจุดสมดุลระหว่างง่ายมากและยากมาก ปัญหาที่คอมพิวเตอร์ควอนตัมในปัจจุบันสามารถรับมือได้ แต่คอมพิวเตอร์คลาสสิกมีปัญหา

คลาสความซับซ้อน

ความยากของปัญหาเหล่านี้ถูกจัดหมวดหมู่และวิเคราะห์ในสาขาหนึ่งของวิทยาการคอมพิวเตอร์ที่เรียกว่าทฤษฎีความซับซ้อนในการคำนวณ มีคลาสความซับซ้อนจำนวนมากในการประมวลผลคลาสสิก แต่บางส่วนที่พื้นฐานที่สุดได้แก่:

- P: ปัญหาที่แก้ได้ในเวลา polynomial เมื่อขนาดของปัญหาเพิ่มขึ้น แก้ได้ง่าย

- NP: ย่อมาจาก nondeterministic polynomial ปัญหาเหล่านี้อาจแก้ได้ไม่จำเป็นต้องอยู่ในเวลา polynomial แต่คำตอบสามารถตรวจสอบได้ในเวลา polynomial

- NP-complete คือปัญหาที่ยากที่สุดใน NP และไม่มีโซลูชัน polynomial ที่รู้จัก ที่นี่คือที่อยู่ของปัญหาที่มีชื่อเสียงอย่าง traveling salesman และเกม Sudoku

- BPP หรือ bounded-error polynomial ซึ่งเป็นปัญหาที่แก้ได้ภายในขีดจำกัดข้อผิดพลาดบางอย่างโดยคอมพิวเตอร์คลาสสิกแบบ probabilistic ในเวลา polynomial

เมื่อแนวคิดของการประมวลผลควอนตัมถูกคิดค้น ผู้คนใช้ความพยายามอย่างมากในการหาว่าคอมพิวเตอร์ประเภทใหม่นี้จะสามารถแก้ปัญหาคลาสไหนได้อย่างมีประสิทธิภาพ คลาสของปัญหาใหม่ถูกสร้างขึ้น:

- BQP หรือ bounded-error quantum polynomial ซึ่งเป็นสิ่งเทียบเท่าควอนตัมของ BPP: เป็นคลาสของปัญหาการตัดสินใจที่แก้ได้โดยคอมพิวเตอร์ควอนตัมในเวลา polynomial โดยมีโอกาสผิดพลาดเล็กน้อย

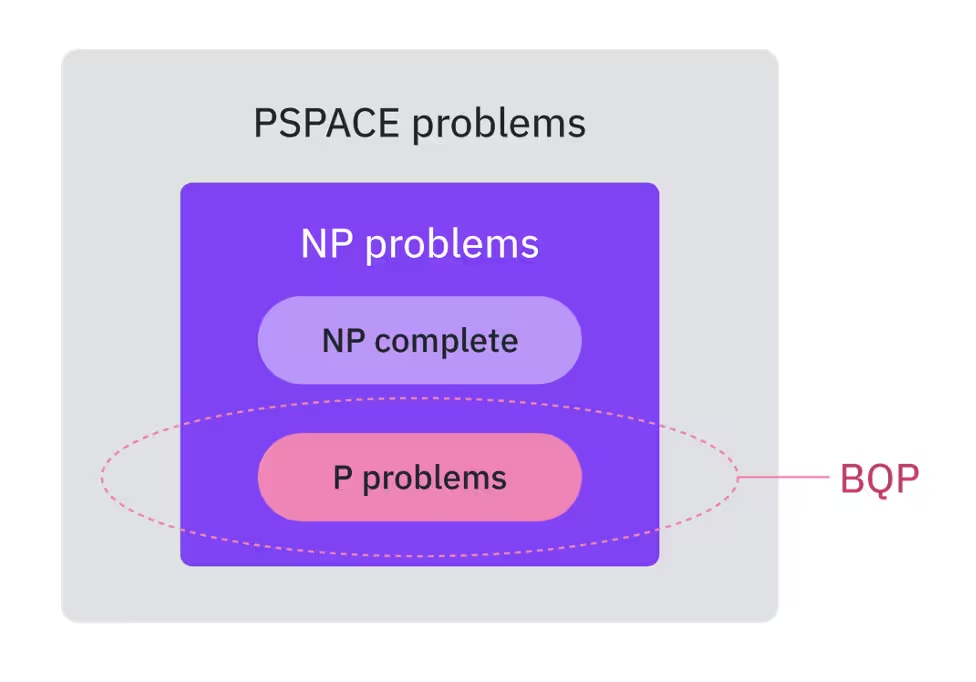

คลาสทั้งหมดนี้อยู่ในคลาสขนาดใหญ่กว่าที่เราเรียกว่า PSPACE ด้านบนคือแผนภาพของความสัมพันธ์ที่สันนิษฐานระหว่างคลาสความซับซ้อนบางส่วน แต่พิสูจน์ทางคณิตศาสตร์ได้ยากมาก คุณจะสังเกตเห็นว่า BQP ไม่จำเป็นต้องทับซ้อนกับ NP-complete แต่คุณอาจเคยเห็นวิธีการประมวลผลควอนตัมบางอย่างที่พยายามแก้ปัญหาใน NP-complete

ความเข้าใจผิดที่พบบ่อยคือไม่มีประโยชน์ในการสำรวจโซลูชันควอนตัมสำหรับปัญหาที่ยังไม่พบหลักฐานทางคณิตศาสตร์ว่ามีการเร่งความเร็วควอนตัม แต่การพิสูจน์ทางคณิตศาสตร์ว่าอัลกอริทึมควอนตัมเร็วกว่าคู่คลาสสิกนั้นยากมาก Shor's และ Grover's เป็นเพียงสองในตัวอย่างจำนวนน้อยที่ทำสำเร็จจนถึงตอนนี้ ในความเป็นจริง การพิสูจน์อย่างเข้มงวดว่า P และ NP แตกต่างกันเป็นหนึ่งในคำถามเปิดที่ฉาวโฉ่ที่สุดในวิชาคณิตศาสตร์ทั้งหมด แม้ว่าสัญชาตญาณทั้งหมดบอกว่าต้องเป็นเช่นนั้น

แต่วิธีที่อัลกอริทึมปรับขนาดตามขนาดปัญหาที่เพิ่มขึ้น ซึ่งสะท้อนในคลาสความซับซ้อน ไม่ได้เป็นคุณสมบัติที่เกี่ยวข้องที่สุดของอัลกอริทึมเสมอไป การปรับขนาดนี้มักเป็นสถานการณ์เลวร้ายที่สุด เป็นไปได้มากที่ในทางปฏิบัติ สถานการณ์เลวร้ายที่สุดไม่ใช่สิ่งที่เราพบบ่อยที่สุด

แค่การพิสูจน์ความยากทำได้ยากไม่ได้หมายความว่าเราไม่สามารถก้าวหน้าได้ เราแนะนำแนวคิดของโซลูชัน heuristic ถ้าคุณเป็นนักทดลอง คุณน่าจะรู้จักและชอบโซลูชันประเภทนี้ Heuristic คือวิธีการใด ๆ ในการแก้ปัญหาที่เป็นประโยชน์ในทางปฏิบัติ แต่ไม่จำเป็นต้องเหมาะสมที่สุด เนื่องจากโซลูชันไม่จำเป็นต้องเหมาะสมที่สุดเพื่อเป็นประโยชน์ ตัวอย่างเช่น ลองนึกถึงการประยุกต์ใช้ทางการเงิน เรายังไม่พบการเร่งความเร็วแบบเลขชี้กำลังสำหรับอัลกอริทึมทางการเงินส่วนใหญ่ที่ควอนตัมสามารถใช้ได้ แต่��เราไม่จำเป็นต้องมีโซลูชันที่เหมาะสมที่สุด ในด้านการเงิน แม้แต่โซลูชันที่มีประสิทธิภาพมากขึ้นเพียง 0.1% ก็อาจเท่ากับกำไรหลายพันล้านดอลลาร์

คอมพิวเตอร์ควอนตัมในปัจจุบันและข้อจำกัด

แล้วเราจะรู้ได้อย่างไรว่า use case และปัญหาอะไรที่อาจเหมาะสมสำหรับการประมวลผลควอนตัมในตอนนี้? มีเหตุผลที่ดีพอที่จะเชื่อว่าสามารถพบ quantum utility หรือแม้แต่ advantage ได้ทั้งตอนนี้หรือในอนาคตอันใกล้?

บางทีอาจง่ายกว่าถ้าจะบอกสิ่งที่ปัญหาต้องไม่มีก่อน มันไม่สามารถต้องการ Qubit จำนวนมาก เรายังไม่มีโปรเซสเซอร์ที่มี Qubit หลายพันถึงล้านตัว นั่นเป็นหนึ่งในเหตุผลหลักที่ Shor's algorithm และอื่น ๆ ยังห่างไกลจากการนำไปใช้จริง Circuit ก็ไม่สามารถลึกเกินไป ขีดจำกัดของความลึก Circuit ขึ้นอยู่กับหลายปัจจัย แต่โดยทั่วไปถ้าการทดลองของคุณต้องการความลึกที่คุณยังไม่เคยเห็นในเอกสารวิชาการ มันน่าจะใช้ไม่ได้ และสุดท้าย อัลกอริทึมประเภทใด ๆ ที่เราทราบว่าต้องการการแก้ไขข้อผิดพลาดยังทำไม่ได้

ข้อจำกัดทั้งหมดนี้ได้รับการตอบสนองใน IBM Quantum® roadmap และเราคาดว่าจะได้รับการแก้ไขข้อผิดพลาดในต้นปี 2030 แต่ตอนนี้ เราต้องมองหาการทดลองที่ใช้ Qubit ส่วนใหญ่ที่มีอยู่บน QPU ที่กำหนด เรายังเน้นความสำคัญของการลดและระงับข้อผิดพลาด และสุดท้าย ควรมีการขยายไปสู่การประยุกต์ใช้ในอนาคตที่สำคัญสำหรับสังคมและที่เราอาจเห็นนำไปสู่ quantum advantage ในที่สุด

พื้นที่การประยุกต์ใช้และ Use Cases

ตอนนี้มาพูดถึงตัวอย่างของ use case ซึ่งอยู่ใน 3 หมวดหมู่หลักที่เราระบุว่าน่าจะเห็นผลลัพธ์ที่ดีในระยะใกล้ถึงกลาง:

-

การจำลองธรรมชาติ วิธีการคลาสสิกในปัจจุบันสำหรับการจำลองอะตอมและโมเลกุลมีข้อจำกัดจากคำอธิบายทางคณิตศาสตร์ที่ไม่มีประสิทธิภาพของโครงสร้างอะตอม การจัดเก็บและจัดการสถานะควอนตัมต้องใช้ทรัพยากรจำนวนมากแบบเลขชี้กำลังบนคอมพิวเตอร์คลาสสิก แต่สามารถทำได้อย่างมีประสิทธิภาพบนคอมพิวเตอร์ควอนตัม สิ่งนี้อาจนำไปสู่การพัฒนาในการกักเก็บคาร์บอนไดออกไซด์ แบตเตอรี่ทางเลือก หรือการประดิษฐ์ยาใหม่ อัลกอริทึมที่เกี่ยวข้องเป็นพิเศษในพื้นที่นี้ได้แก่: Variational Quantum Eigensolver (VQE) ซึ่งใช้ประมาณ��คุณสมบัติบางอย่างของวัสดุ เช่น สถานะสมดุลหรือพลังงานต่ำสุด; อัลกอริทึม Time Dynamics Simulation (TDS) ซึ่งใช้ประมาณฟังก์ชันการตอบสนองหรือคุณสมบัติสเปกตรัมของวัสดุ; และผู้มาใหม่ Sample-based Quantum Diagonalization (SQD) ซึ่งเราคิดว่าจะได้ยินเพิ่มขึ้นมากในอนาคตอันใกล้

-

การปรับให้เหมาะสม พื้นที่นี้แพร่หลายในการประมวลผล ดังนั้น use case จึงมีมากและหลากหลาย ตัวอย่างบางส่วนที่เราได้ยินบ่อยคือการปรับพอร์ตโฟลิโอในด้านการเงิน การออกแบบอุตสาหกรรม และการกระจายสินค้าและห่วงโซ่อุปทาน อัลกอริทึมที่พบบ่อยที่สุดที่คุณจะได้ยินเกี่ยวข้องกับการเงินคืออัลกอริทึมที่เราได้กล่าวถึงในเชิงลึกแล้ว: quantum approximate optimization algorithm หรือ QAOA

-

Quantum machine learning พื้นที่นี้สร้างความตื่นเต้นมากในช่วงไม่กี่ปีที่ผ่านมา แต่เป็นไปได้ว่า QML จะไม่เป็นประโยชน์เร็วเท��่ากับการจำลอง แต่ยังมีอัลกอริทึมที่น่าประทับใจบางอย่างที่กำลังพัฒนาเพื่อตอบสนอง use case สำคัญบางอย่าง use case ที่เป็นไปได้บางส่วนได้แก่การประมวลผลภาษาธรรมชาติ การวิเคราะห์การรับส่งข้อมูลเครือข่าย และแม้แต่การตรวจจับการฉ้อโกงในธุรกรรมทางการเงิน อัลกอริทึมที่เกี่ยวข้องในพื้นที่นี้ได้แก่ quantum support vector machine (QSVM) quantum neural networks (QNN) และ quantum generative adversarial networks

ในพื้นที่การประยุกต์ใช้กว้าง ๆ เหล่านี้ ชุมชนเห็นประโยชน์ในการทำงานร่วมกันของกลุ่มที่มุ่งเน้นหัวข้อเฉพาะมากขึ้น IBM® ริเริ่มโครงการที่เรียกว่า Working Groups เพื่อช่วยให้ผู้ร่วมมือพบกันและสร้างการทำงานร่วมกันที่มีประสิทธิผลใน 4 พื้นที่เฉพาะ: การดูแลสุขภาพและวิทยาศาสตร์ชีวภาพ วัสดุและการประมวลผลประสิทธิภาพสูง (HPC) ฟิสิกส์พลังงานสูง และการปรับให้เหมาะสม และเมื่อไม่นานมานี้ ได้มีการสร้าง Working Group ที่ห้าเกี่ยวกับความยั่งยืน

ตอนนี้เราจะซูมเข้าไปที่ปัญหาบางอย่างที่ Working Group เหล่านี้เพิ่งจัดการ เป้าหมายหลักที่นี่ไม่ใช่เพื่อเข้าใจรายละเอียดทั้งหมดของการทดลอง ซึ่งอาจน่ากลัวแม้แต่สำหรับผู้เชี่ยวชาญหากเอกสารอยู่นอกพื้นที่ความเชี่ยวชาญของคุณเล็กน้อย เป้าหมายคือเพียงเพื่อช่วยพัฒนาสัญชาตญาณสำหรับประเภทของปัญหาที่คอมพิวเตอร์ควอนตัมเหมาะสม และวิธีที่เราจัดการกับปัญหาเหล่านั้น และหากคุณสนใจ เราขอแนะนำให้อ่านเอกสารฉบับเต็ม

Use Case 1: การจำลองพลวัตของแฮดรอน

ก่อนอื่น เราจะเจาะลึกเอกสารของกลุ่ม Martin Savage จากมหาวิทยาลัยวอชิงตันที่ชื่อ Quantum Simulations of Hadron Dynamics in the Schwinger Model Using 112 Qubits

ถ้าคุณไม่ใช่นักฟิสิกส์พลังงานสูง คุณอาจยังคุ้นเคยกับคำว่า "แฮดรอน" อย่างใน Large Hadron Collider (LHC) ซึ่งเป็นเครื่องเร่งอนุภาคขนาดยักษ์ เส้นรอบวง 27 กิโลเมตร ที่ทำให้สามารถสังเกต Higgs boson ได้ในที่สุด แฮดรอนคืออนุภาคผสมใต้อะตอมที่ประกอบด้วยอนุภาคขนาดเล็กอื่น ๆ ที่เรียกว่าควาร์ก ตัวอย่างของแฮดรอนได้แก่นิวตรอนและโปรตอน

เพื่อให้บริบทเล็กน้อย LHC ถูกสร้างขึ้นเพื่อให้สามารถศึกษาฟิสิกส์พื้นฐานโดยชนอนุภาคที่พลังงานสูงมาก ด้วย LHC นักวิทยาศาสตร์หวังที่จะเรียนรู้เพิ่มเติมเกี่ยวกับจักรวาลยุคแรกและกฎพื้นฐานของธรรมชาติ ในหลักการ ปฏิกิริยาของอนุภาคเหล่านี้สามารถจำลองได้ตั้งแต่ต้นจนจบด้วยคอมพิวเตอร์ควอนตัมที่มีพลังเพียงพอ เรายังไม่ถึงจุดนั้น แต่กำลังก้าวหน้า

Schwinger model เป็นแบบจำลองที่เรียบง่ายและได้รับความนิยมที่ใช้จำลองพลวัตบางอย่าง มันเป็นแบบจำลองที่อธิบายพฤติกรรมของอิเล็กตรอนและโพซิตรอนที่มีปฏิกิริยาผ่านโฟตอนใน 1+1D หมายความว่าเวลาและมิติเชิงพื้นที่หนึ่ง แบบจำลองนี้มีความคล้ายคลึงกันมากกับ quantum chromodynamics (QCD) ซึ่งอธิบายวิธีที่ควาร์กและแฮดรอนมีปฏิกิริยา แต่ QCD ยากมากในการจำลอง ดังนั้น Schwinger model จึงมักถูกใช้เป็นแบบจำลองทดสอบเพื่อสืบสวนปรากฏการณ์บางอย่างที่พบในทั้งสอง

เพื่อเข้าใจว่าทำไมพวกเขาถึงจัดการปัญหานี้ ลองถามตัวเองด้วยคำถามต่อเนื่อง

ก่อนอื่น ทำไมพวกเขาถึงมีเหตุผลที่เชื่อว่าการจำลองนี้บนคอมพิวเตอร์ควอนตัมจะได้ผลเลย? ในกรณีนี้ อิเล็กตรอนและโพซิตรอนใน Schwinger model มีผลการกรองที่ทำให้ความสัมพันธ์ระหว่างเฟอร์มิออนที่ห่างไกลลดลงแบบเลขชี้กำลังตามระยะทาง นี่หมายความว่าไม่จำเป็นต้องมีการมีปฏิกิริยาระยะยาวจาก Qubit ด้านหนึ่งของชิปไปอีกด้านหนึ่งมากนัก ซึ่งเรารู้ว่าเกิดข้อผิดพลาดได้ง่าย ดังนั้นสิ่งนี้ยอดเยี่ยมสำหรับฮาร์ดแวร์ที่เรามีในปัจจุบัน

ต่อไป ทำไมหัวข้อนี้ถึงน่าสนใจ? ฟิสิกส์พลังงานสูงโดยทั่วไปน่าสนใจมาก ผู้คนยินดีที่จะใช้จ่ายหลายพันล้านดอลลาร์เพื่อสร้าง LHC และนักวิทยาศาสตร์และนักเทคนิคหลายพันคนทั่วโลกได้อุทิศอาชีพของตนให้กับสาขานี้ แม้ว่า Schwinger model จะเรียบง่ายและไม่ได้ออกแบบมาเพื่อครอบคลุมสามมิติเชิงพื้นที่ แต่ยังคงเป็นการลดความซับซ้อนที่มีประโยชน์ของทฤษฎีเต็มรูปแบบ

สุดท้าย งานนี้ทำอย่างไร หรือเราจะเข้าถึงปัญหาอย่างไรถ้าเราต้องการทำงานต่อ? ในการทดลองประเภทการจำลอง VQE เป็นหนึ่งในวิธีการที่พบบ่อยที่สุด และขั้นตอนแรกมักจะเหมือนกันเสมอ: เตรียม ground state ในกรณีนี้คือ vacuum state ในการทดลองนี้ พว�กเขาใช้ VQE เวอร์ชันใหม่ที่เรียกว่า SC-ADAPT-VQE (ซึ่งย่อมาจาก Scalable Circuits - Adaptive Derivative-Assembled Pseudo-Trotter ansatz-VQE) เพื่อเตรียมทั้ง ground state และ wave packet ของแฮดรอนบน vacuum นี้ ขั้นตอนถัดไปคือการให้แฮดรอนวิวัฒนาการในเวลา สุดท้าย ระบุ observable ที่คุณต้องการวัดและวัดมัน

ถ้าขั้นตอนเหล่านั้นฟังดูคุ้นเคย ยกเว้นส่วน wave packet ของแฮดรอน นั่นเป็นเพราะขั้นตอนเหล่านี้คล้ายกับสิ่งที่เราครอบคลุมในตัวอย่าง QAOA ในบทเรียนที่แล้ว เราเริ่มในสถานะที่คุ้นเคย (ที่นี่คือ vacuum state) แล้วเราปล่อยให้มันวิวัฒนาการในเวลาด้วยชุดของ Hamiltonian ที่ถูก exponentiate อัลกอริทึม variational หลายอย่างทำตามวิธีการทั่วไปนี้ ความแตกต่างที่สำคัญที่นี่คือเราสร้าง wave packet ของแฮดรอนที่อยู่ตรงกลาง Circuit ของเรา ก่อนที่เราจะเริ่มปล่อยให้มันวิวัฒนาการ

แล้วเราสร้าง wave packet อย่างไร? บน vacuum แฮดรอนสามารถถูกกระตุ้นได้โดยการสร้างคู่เฟอร์มิออน-แอนติ��เฟอร์มิออนบนตำแหน่งที่อยู่ติดกัน โดยการเตรียม superposition ของแฮดรอนดังกล่าวในตำแหน่งต่าง ๆ สามารถเตรียม wave packet ที่กำหนดเองได้ ผู้เขียนวาง wave packet ไว้ตรงกลาง Circuit เพื่อสังเกตการวิวัฒนาการโดยไม่กระทบขอบเขต

แต่จำไว้: เกมเมื่อทำงานกับ QPU ที่มีสัญญาณรบกวนคือการรักษาความลึกของ Circuit ให้จัดการได้ เพื่อทำสิ่งนี้ โปรโตคอล SC-ADAPT-VQE ใช้ความสมมาตรและลำดับชั้นในระดับความยาวเพื่อกำหนด quantum circuit ที่มีความลึกต่ำสำหรับการเตรียมสถานะ สิ่งนี้จะสร้าง ansatz ที่มีพารามิเตอร์จำนวนน้อยกว่า และด้วยเหตุนี้จึงมีความลึกน้อยกว่า

การทดลองถูกรันบนอุปกรณ์ IBM Quantum Heron และรวมถึงการลดข้อผิดพลาดและการระงับข้อผิดพลาดหลายประเภท: dynamical decoupling, zero noise extrapolation, Pauli twirling และเทคนิคที่พัฒนาขึ้นใหม่ที่เรียกว่า operator decoherence renormalization

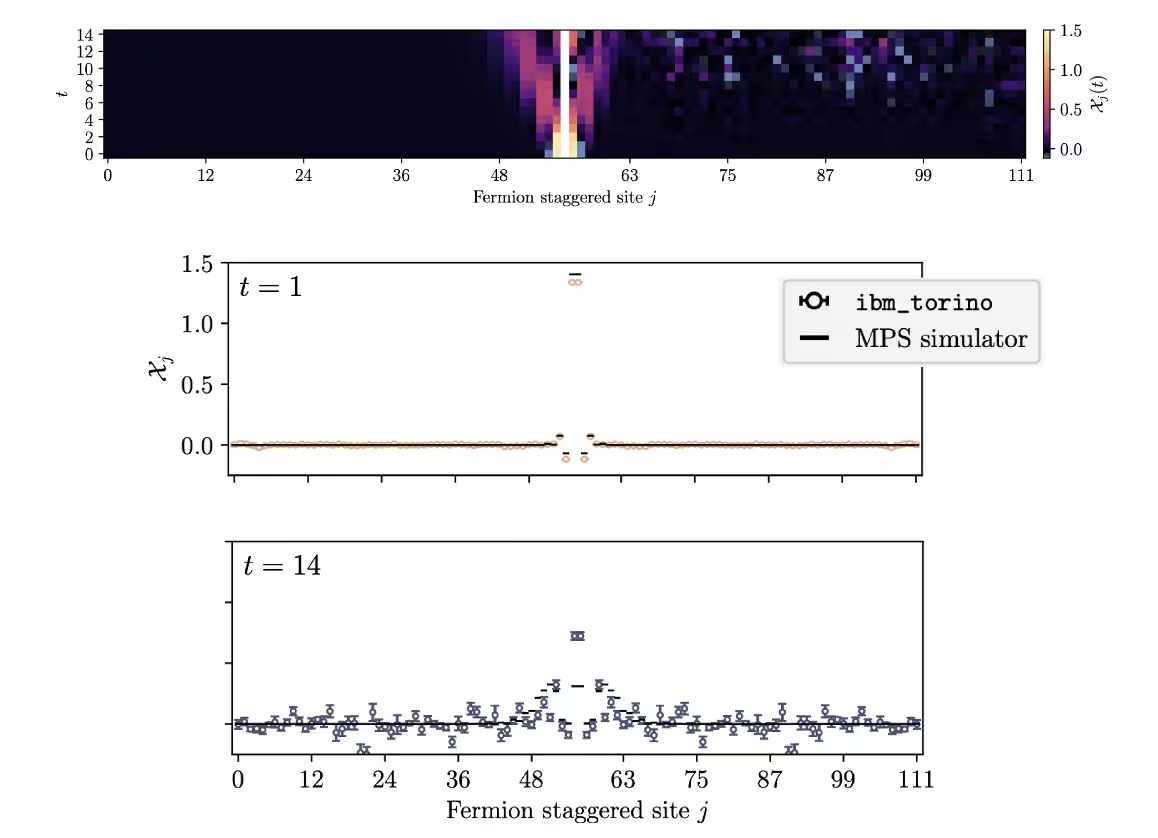

ด้านบนคือรูปจากเอกสารที่แสดง observable ที่น่าสนใจ ซึ่งก็คือ chiral condensate ซึ่งเป็นเฟสของไหลยิ่งยวดของแฮดรอน ตอนนี้ เราสามารถเห็น wave packet ที่ศูนย์กลางของตำแหน่งที่กำหนดสำหรับการทดลองนี้ เส้นสีดำคือผลลัพธ์ที่ปราศจากข้อผิดพลาดจากการจำลองคลาสสิก (ที่มีค่าใช้จ่ายสูงในการคำนวณ) ในขณะที่จุดที่มี error bar คือผลลัพธ์จากคอมพิวเตอร์ควอนตัม IBM 133 Qubit ชื่อ Torino

เราเห็นขั้นตอนเวลาสองขั้นในการวิวัฒนาการ wave packet ที่เวลา คุณจะเห็นว่า chiral condensate แคบและเฉพาะที่ และยังตรงกับการจำลองคลาสสิกได้ดี ที่ มันกระจายออกมากขึ้น การเปรียบเทียบกับ simulator ไม่สมบูรณ์แบบเท่า แต่คุณยังสามารถเห็นความสอดคล้องที่ดีมากระหว่างทฤษฎีและข้อมูลได้อย่างชัดเจน ซึ่งเป็นที่น่าพอใจ

โดยสรุป นี่เป็นตัวอย่างที่ยอดเยี่ยมของงานจำลองประเภทที่คุณอาจไม่คิดในตอนแรกว่าจะนำการประมวลผลควอนตัมมาใช้ แต่แสดงให้เห็นถึงความมุ่งหมายที่แท้จริง มันไม่สมบูรณ์แบบ แต่คุณไม่จำเป็นต้องเป็นผู้เชี่ยวชาญด้านฟิสิกส์อนุภาคเพื่อดูว่าคอมพิวเตอร์ควอนตัมทำนายการแพร่กระจายออกด้านนอกของ wave packet ได้อย่างแม่นยำ ซึ่งนั่นคือสิ่งที่เราคาดหวัง หวังว่างานใน�อนาคตในพื้นที่นี้จะดำเนินต่อไปและนักฟิสิกส์พลังงานสูงจะยังคงหาวิธีที่จะรวมการประมวลผลควอนตัมเข้ากับขั้นตอนการทำงานของพวกเขา เป้าหมายคือการแก้ปัญหาทางทฤษฎีที่ยากได้อย่างแม่นยำมากขึ้นและใช้การทดลองเพื่อยอมรับหรือปฏิเสธทฤษฎีในความหวังที่จะค้นพบฟิสิกส์ใหม่ สร้างตัวตรวจจับที่ดีขึ้น และนำไปสู่ความเข้าใจธรรมชาติที่ระดับพื้นฐานที่สุดได้ดีขึ้น

Use Case 2: การปรับให้เหมาะสมของ Ising spin-glass

ตัวอย่างถัดไปมุ่งเน้นที่การปรับให้เหมาะสมและจะเป็นการเจาะลึกเอกสารที่ชื่อ Bias-Field Digitized Counterdiabatic Quantum Optimization ซึ่งทำโดยสมาชิกทีม Kipu Quantum และมหา�วิทยาลัย Basque Country ในสเปน

ในเอกสาร ผู้เขียนพัฒนาวิธีการปรับให้เหมาะสมใหม่และนำมาใช้กับการหา ground state ของ Ising spin-glass ดังที่เราได้กล่าวไว้ก่อนหน้า ปัญหาการปรับให้เหมาะสมแบบ combinatorial หลายอย่างสามารถกำหนดสูตรใหม่เป็นการแก้หาสถานะพลังงานต่ำของ Ising Hamiltonian ได้ Ising model อธิบายการมีปฏิกิริยาของอาร์เรย์ของสปินระดับไมโครสโคปิก ในบางระบบ แบบจำลองทำนายว่าสปินจะทำตัวเหมือนแก้ว ซึ่งโมเมนต์แม่เหล็กไม่เป็นระเบียบเหนือ "อุณหภูมิการแข็งตัว" ที่เรียกว่า

เราจะเริ่มเหมือนเดิมด้วยนิยามต่าง ๆ อย่างแรกคือ counterdiabatic ซึ่งเป็นประเภทของการวิวัฒนาการที่ระงับผลกระทบ non-adiabatic ที่ระบบประสบ โดยไม่คำนึงว่ากระบวนการเหล่านั้นเกิดขึ้นเร็วแค่ไหน ระลึกถึง adiabatic theorem จากตอนที่แล้ว คุณมักต้องวิวัฒนาการระบบอย่างช้า ๆ หากต้องการให้มันอยู่ใน ground state สิ่งนี้เป็นปัญหาใหญ่เพราะ�ยิ่งเราต้องวิวัฒนาการสิ่งต่าง ๆ ช้าลงเท่าไหร่ ก็ยิ่งมีเวลามากขึ้นสำหรับข้อผิดพลาดที่จะเกิดขึ้น Counterdiabatic driving (CD) มีเป้าหมายที่จะต่อสู้กับสิ่งนี้โดยการเพิ่ม term ที่ต่อต้านการกระตุ้นที่ไม่ต้องการเหล่านี้ แนวคิดหลักที่นี่คือการเร่งการทดลองทั้งหมดและลดความลึกของ quantum circuit โดยการระงับการกระตุ้นที่อาจทำให้เกิด transition ที่ไม่ต้องการ

ตอนนี้สำหรับ jargon อื่นในชื่อ: bias field อัลกอริทึม iterative อื่น ๆ เช่น VQE นำพารามิเตอร์คลาสสิกเข้าสู่สถานะและใช้ classical optimizer เพื่อค้นหาพื้นที่พารามิเตอร์หลายมิติหาชุดพารามิเตอร์ที่ให้ค่าความคาดหวังต่ำสุดสำหรับ Hamiltonian คงที่ ในกรณีนี้ พวกเขากลับเปลี่ยน Hamiltonian แต่ละครั้ง เคลื่อนที่แบบ adiabatic จากกรณีที่รู้จักไปสู่กรณีที่สนใจ เพื่อเปลี่ยน Hamiltonian พวกเขาเพียงแค่ใช้ค่าความคาดหวัง Pauli-Z จาก iteration หนึ่งโดยตรงเป็น bias field ใน Hamiltonian สำหรับ iteration ถัด�ไป ด้วยวิธีนี้ พวกเขานำพลวัตไปสู่โซลูชันจริงโดยไม่ต้องการ classical optimizer

แล้วทำไมการทดลองนี้ถึงน่าสนใจ? Ising spin-glass น่าสนใจเป็นพื้นฐานในฟิสิกส์ แต่วิธีการใหม่นี้ยิ่งกว้างขวางกว่านั้น สามารถนำไปใช้กับปัญหาการปรับให้เหมาะสมหลายอย่าง ดังนั้นเอกสารจึงได้รับความสนใจอย่างกว้างขวาง

และทำไมเราถึงคิดว่าสิ่งนี้จะได้ผล? อัลกอริทึมที่พวกเขาเสนอเร่งการวิวัฒนาการเพื่อลดความลึกของ Circuit ขณะเดียวกันก็ระงับ non-adiabatic transition นอกจากนี้ยังไม่พึ่งพา classical optimization subroutine ซึ่งอาจเป็นปัญหาที่นำไปสู่ barren plateau และการติดอยู่ที่ local minima สุดท้าย ผู้เขียนยังตรวจสอบให้แน่ใจว่าการมีปฏิกิริยาในปัญหา Hamiltonian สอดคล้องกับการเชื่อมต่อฮาร์ดแวร์ใน QPU จริง ซึ่งสำคัญมากเสมอ

แล้ววิธีนี้ทำงานอย่างไร? อีกครั้ง ไม่ใช้ classical optimizer ต่างจากอัลกอริทึมควอนตัม iterative อื่น ๆ ส่วนใหญ่ แทนที่ด้วย��การป้อนโซลูชันจากแต่ละ iteration เป็น input สำหรับ iteration ถัดไป อัลกอริทึม bias-field digitized quantum optimization ค่อย ๆ ปรับปรุง ground state ทำให้ใกล้เคียงสถานะวิวัฒนาการสุดท้ายมากขึ้นเรื่อย ๆ และรวมกับโปรโตคอล counterdiabatic เราสามารถทำสิ่งนี้ได้แม้กับ quantum circuit ที่มีความลึกสั้นที่ควรทำงานได้ราบรื่นบนฮาร์ดแวร์ที่มีสัญญาณรบกวน

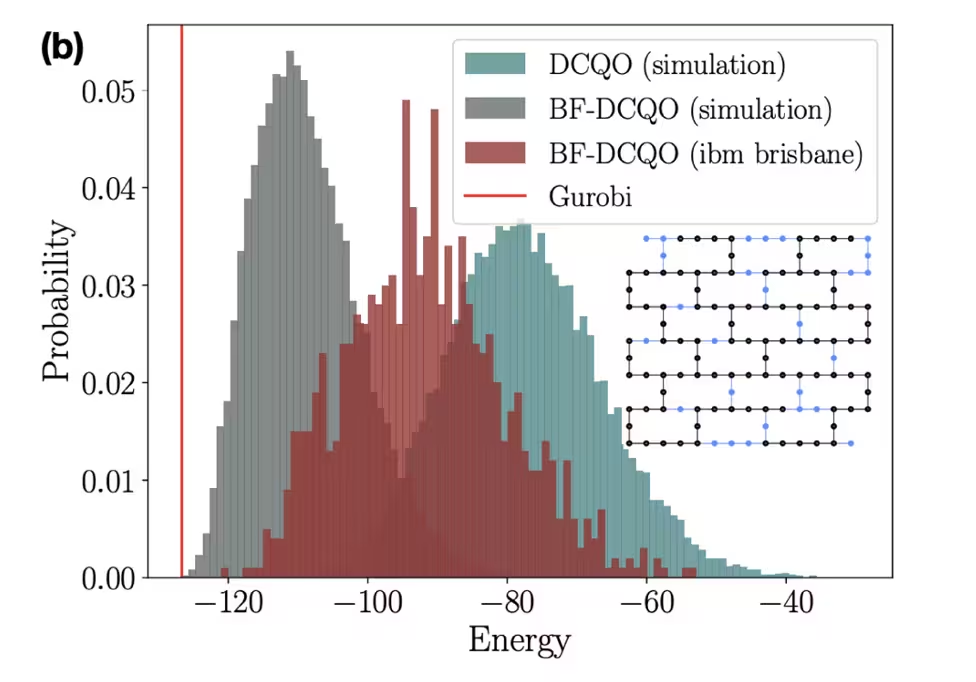

ดังนั้น เมื่อทำการทดลอง ผู้เขียนเลือกรันอัลกอริทึมบนคอมพิวเตอร์ IBM Quantum 127 Qubit Brisbane ด้านล่างคือรูปที่แสดง iteration ที่ 8 ของอัลกอริทึมการปรับให้เหมาะสมสำหรับ nearest-neighbor spin-glass instance ที่สร้างแบบสุ่มบน 100 Qubit พวกเขาเปรียบเทียบผลการจำลองคลาสสิกในอุดมคติจาก DCQO และ BF-DCQO รวมถึงผลการทดลองที่รันบนคอมพิวเตอร์ควอนตัม พวกเขายังแสดงผลจาก Gurobi ซึ่งเป็น classical solver เป็นการอ้างอิง ด้วยเพียง 10 iterations BF-DCQO ให้ประสิทธิภาพที่ดีขึ้นอย่างมากเมื่อเปรียบเทียบกับ DCQO แม้ว่าผลการทดลองจะแตกต่างจากผลในอุดมคติเล็กน้อยเนื่องจากสัญญาณรบกวน แต่ประสิทธิภาพยังดีกว่า DCQO ในอุดมคติ สิ่งนี้แสดงให้เห็นว่ายังมีความก้าวหน้าที่ยอดเยี่ยมในด้านการปรับให้เหมาะสมด้วยควอนตัม และผลลัพธ์ที่ดีถูกรายงานบน Qubit มากกว่า 100 ตัวเป็นครั้งแรก

Use Case 3: การทำนายโครงสร้างรองของ mRNA

สุดท้าย เราจะพูดถึงเอกสารจาก Moderna Pharmaceuticals ที่ชื่อ mRNA Secondary Structure Prediction Using Utility-Scale Quantum Computers

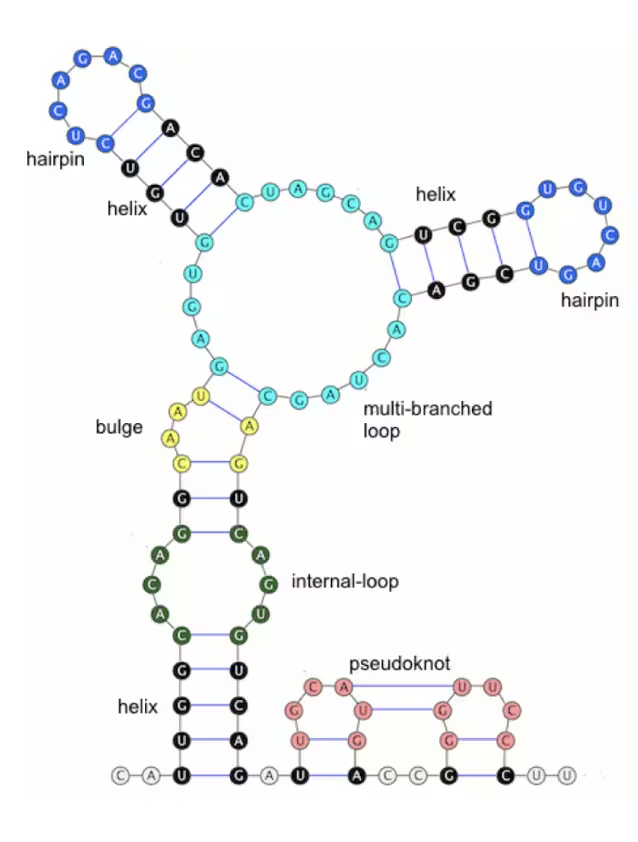

ก่อนอื่น ทบทวนสั้น ๆ เกี่ยวกับ mRNA Messenger RNA เป็นประเภทของ RNA ที่เกี่ยวข้องกับการสังเคราะห์โปรตีน โดยพื้นฐานแล้วมันอ่านคำสั่งที่ให้โดย DNA โครงสร้างรองของ mRNA คือวิธีที่สายพันจับตัว ดังที่แสดงในแผนภาพด้านล่าง และปัญหาการทำนายโครงสร้างรอง RNA คือปัญหาของการหาการพับที่เสถียรที่สุดของลำดับฐานหรือนิวคลีโอไทด์ที่ประกอบ RNA: adenine (A), cytosine (C), uracil (U) และ guanine (G) รูปด้านล่างแสดงโครงสร้างการพับทั่วไปที่พบใน mRNA แต่ละสีแสดงถึงประเภทต่าง ๆ ของโครงสร้างรอง สิ่งที่ทำให้โครงสร้างหนึ่งดีกว่าอีกอันหนึ่งไม่เป็นที่เข้าใจดี สิ่งที่เราทำได้คือคำนวณว่าโครงสร้างใดให้พลังงานอิสระต่ำสุดเมื่อเทียบกับสถานะที่ยังไม่พับ และนั่นคือที่ที่คอมพิวเตอร์ควอนตัมเข้ามามีบทบาท

แล้วทำไมโครงสร้างรองของ mRNA ถึงสำคัญ? การทำนายที่แม่นยำของมันสำคัญไม่เพียงแต่ในการทำความเข้าใจ DNA และยีนของเรา แต่ยังสำหรับการออกแบบยารักษาโรคที่อาศัย RNA เช่นวัคซีน COVID-19

สิ่งนี้เป็นที่รู้กันมานานแล้วว่าเป็นปัญหาการปรับให้เหมาะสมที่น่าเกรงขามสำหรับคอมพิวเตอร์คลาสสิกเนื่องจากจำนวนการกำหนดค่าที่เป็นไปได้มหาศาล สำหรับการกำหนดค่าบ�างอย่าง เป็นที่ทราบว่าเป็นปัญหา NP-complete อย่างไรก็ตาม บนคอมพิวเตอร์ควอนตัม เราสามารถกำหนดการทำนายโครงสร้างรองเป็นปัญหาการปรับให้เหมาะสม binary ซึ่งเป็นสิ่งที่เรารู้วิธีจัดการ นอกจากนี้ ยังมีหลักฐานในเอกสารวิชาการที่บ่งชี้ว่ามีการทำนาย RNA ที่แม่นยำบนอุปกรณ์ควอนตัมขนาดเล็กและ quantum simulator แต่จะได้ผลกับฮาร์ดแวร์ขนาดใหญ่กว่าหรือไม่?

การทดลองนี้ดำเนินการโดยใช้ conditional value at risk variational quantum eigensolver ซึ่งเป็นการดัดแปลงของอัลกอริทึม VQE แบบดั้งเดิม และคาดว่าจะให้การบรรจบที่ดีกว่า

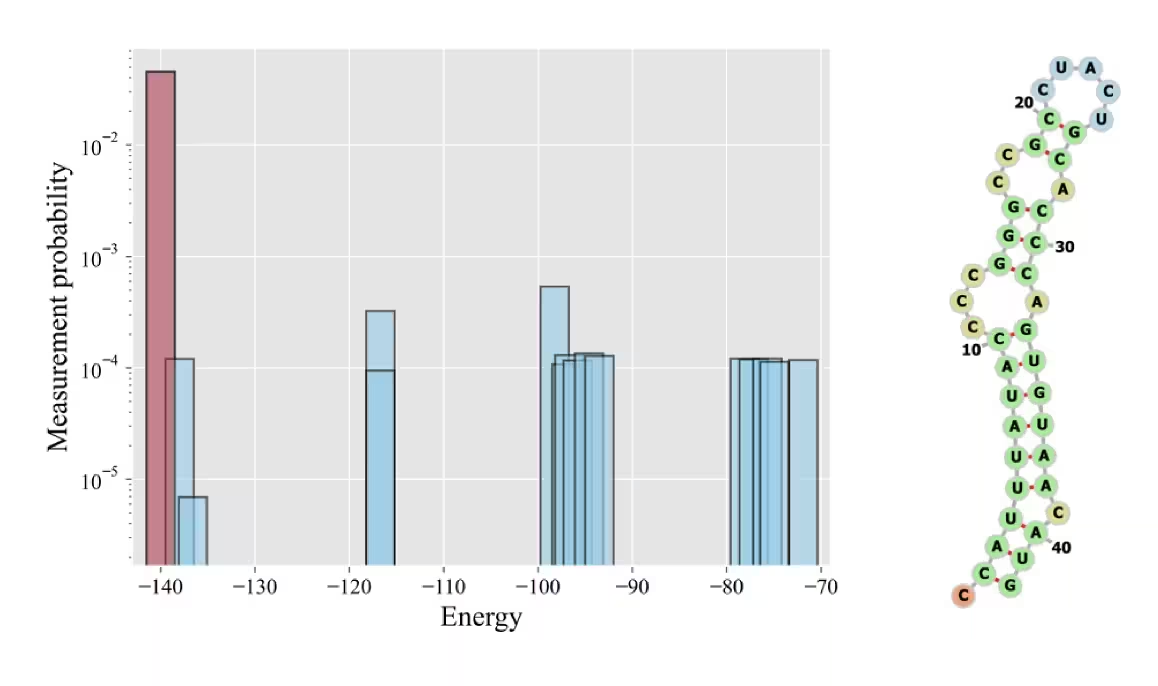

กราฟด้านบนแสดงการกระจายของความน่าจะเป็นของการวัดของ bitstring ที่ถูกสุ่ม พร้อมกับพลังงานที่สอดคล้องสำหรับ instance 42-nucleotide 80-Qubit ที่นี่ bitstring แสดงถึงการจับคู่ของนิวคลีโอไทด์ มันแสดงให้เห็นว่า bitstring พลังงานต่ำสุดที่พบโดยคอมพิวเตอร์ควอนตัมตรงกับ classical solver เปรียบเทียบ ซึ่งยอดเยี่ยม ยังแสดงถึงโครงสร้างที่พับอย่างเหมาะสมที่สุดของสายนิวคลีโอไทด์นั้นตาม bitstring พลังงานต่ำสุดที่คอมพิวเตอร์ควอนตัมพบ

บทสรุป

หวังว่า use case ทั้งสามนี้จะให้บริบทเพียงพอสำหรับให้คุณเข้าใจว่างานที่ล้ำสมัยในสาขานี้ตอนนี้เป็นอย่างไร และมีความมั่นใจในการลองการทดลองควอนตัมใหม่ที่คุณอาจไม่เคยทำมาก่อน

จำไว้ว่า: การประมวลผลควอนตัมไม่เหมาะกับทุกปัญหา และจริง ๆ แล้วนี่เป็นเพียงการพิสูจน์ว่าเราเก่งขึ้นมากเพียงใดในการประมวลผลคลาสสิก แค่คิดว่าคุณสามารถนำการประมวลผลควอนตัมไปใช้กับปัญหาหนึ่งไม่ได้หมายความว่ามันจะให้ผลลัพธ์ที่น่าสนใจ คุณต้องพิจารณาการปรั�บขนาด

ความลึกของ Circuit เป็นดาบสองคม เราต้องการให้มันใหญ่พอสมควรเพื่อทำงานที่น่าสนใจที่คอมพิวเตอร์คลาสสิกทำไม่ได้ แต่ตอนนี้ เราไม่สามารถเพิ่มความลึกมากเกินไปเพราะสัญญาณรบกวนฮาร์ดแวร์จะทำให้ความแม่นยำลดลง มันเกี่ยวกับการหาจุดสมดุลและรู้ว่ามันเป็นเป้าหมายที่เคลื่อนที่อยู่ตลอดเวลา ดังนั้น ใช้เวลาสักพักระหว่างนี้และบทเรียนถัดไปเพื่อคิดถึงปัญหาที่คุณพบในการวิจัยของคุณ และวิธีที่คุณอาจเข้าถึงมันด้วยสิ่งที่เราได้เรียนรู้จนถึงตอนนี้ และบางที โซลูชันของคุณอาจไม่สำเร็จ และนั่นก็ไม่เป็นไร นั่นคือเหตุผลที่สิ่งนี้คือการวิจัย